Malware Protection Test September 2020

File Detection Test mit Execution einschließlich False-Alarm Test

| Datum der Veröffentlichung | 2020-10-15 |

| Datum der Überarbeitung | 2020-10-12 |

| Prüfzeitraum | September 2020 |

| Anzahl der Testfälle | 10102 |

| Online mit Cloud-Konnektivität |  |

| Update erlaubt |  |

| False-Alarm Test inklusive |  |

| Plattform/OS | Microsoft Windows |

Einführung

Beim Malware Protection Test werden schädliche Dateien auf dem System ausgeführt. Während beim Real-World Protection Test das Internet der Vektor ist, können die Vektoren beim Malware Protection Test z.B. Netzlaufwerke, USB sein oder Szenarien abdecken, bei denen sich die Malware bereits auf dem Datenträger befindet.

Bitte beachten Sie, dass wir nicht empfehlen, ein Produkt nur auf der Grundlage eines einzelnen Tests oder sogar nur eines Merkmals im Test zu kaufen. Vielmehr empfehlen wir den Lesern, auch unsere anderen aktuellen Testberichte zu konsultieren und Faktoren wie Preis, Benutzerfreundlichkeit, Kompatibilität und Support zu berücksichtigen. Die Installation einer kostenlosen Testversion ermöglicht es, ein Programm vor dem Kauf im täglichen Gebrauch zu testen.

Im Prinzip werden Internet-Security Suites für Heimanwender in diesen Test einbezogen. Einige Anbieter haben uns jedoch gebeten, stattdessen ihr (kostenloses) Antivirus-Security-Produkt einzubeziehen.

Geprüfte Produkte

Informationen über zusätzliche Engines/Signaturen von Drittanbietern, die in den Produkten verwendet werden: G Data, Total Defense und Vipre verwenden die Bitdefender Engine. F-Secure und Total AV verwenden die AVIRA Engine. AVG ist eine umbenannte Version von Avast.

Alle Produkte wurden auf einem aktuellen 64-Bit Microsoft Windows 10 System installiert. Die Produkte wurden Anfang September mit Standardeinstellungen und unter Verwendung der neuesten Updates getestet.

Testverfahren

Der Malware Protection Test bewertet die Fähigkeit eines Security-Programms, ein System vor, während oder nach der Ausführung vor einer Infektion durch schädliche Dateien zu schützen. Die für jedes getestete Produkt angewandte Methodik ist wie folgt: Vor der Ausführung eines Programms werden alle Test-Samples dem On-Access Scan (Scan bei Zugriff) und On-Demand Scan (Scan bei Anforderung) des Security-Produkts unterzogen. Jeder dieser Scans wird zudem einmal offline und einmal online durchgeführt. Alle Samples die, bei diesen Scans, nicht erkannt wurden, werden dann erst mit Internet- bzw. Cloud-Zugang ausgeführt, damit z.B. die Merkmale der Verhaltenserkennung zum Tragen kommen können. Wenn ein Produkt nicht alle von einem bestimmten Malware-Sample vorgenommenen Änderungen innerhalb eines bestimmten Zeitfenster verhindert oder rückgängig macht, gilt dieser Testfall als Fehlschlag. Wird der Nutzer aufgefordert zu entscheiden, ob ein Malware-Sample ausgeführt werden darf, und werden im Falle der schlechtesten Entscheidung Systemänderungen beobachtet, wird der Testfall als "User Dependent" eingestuft.

Erkennung vs. Schutz

Der File Detection Test, den wir in den vergangenen Jahren durchgeführt haben, war ein reiner Erkennungstest. Das heißt, die Security-Programme wurden nur auf die Fähigkeit getestet, eine schädliche Programmdatei vor der Ausführung zu erkennen. Diese Fähigkeit ist nach wie vor ein wichtiges Merkmal eines Antivirus-Produkts und ist für jeden wichtig, der z.B. prüfen möchte, ob eine Datei harmlos ist, bevor er sie an Freunde, Familie oder Kollegen weiterleitet.

Dieser Malware Protection Test prüft nicht nur die Erkennungsraten, sondern auch die Schutzfunktionen, d.h. die Fähigkeit, ein bösartiges Programm daran zu hindern, tatsächlich Änderungen am System vorzunehmen. In manchen Fällen erkennt ein Antivirus-Programm ein Malware-Sample nicht, wenn es inaktiv ist, wohl aber, wenn es ausgeführt wird. Überdies verwenden einige AV-Produkte eine Verhaltenserkennung, um Versuche eines Programms Systemveränderungen vorzunehmen, die typisch für Malware sind, zu erkennen und diese zu blockieren. Unser Malware Protection Test misst die allgemeine Fähigkeit von Security-Produkten, das System vor, während oder nach der Ausführung von bösartigen Programmen zu schützen. Er ergänzt unseren Real-World Protection Test, der seine Malware-Samples von Live-URLs bezieht, so dass Funktionen wie URL-Blocker zum Einsatz kommen können. Beide Tests umfassen die Ausführung von Malware, die von anderen Funktionen nicht erkannt wird, so dass Funktionen der "letzten Verteidigungslinie" zum Einsatz kommen können.

Ein bedeutender Vorteil von Cloud-Erkennungsmechanismen ist diese: Malware-Autoren sind ständig auf der Suche nach neuen Methoden zur Umgehung von Erkennungs- und Security-Mechanismen. Die Verwendung von Cloud-Erkennungsdiensten ermöglicht es Anbietern, verdächtige Dateien in Echtzeit zu erkennen und zu klassifizieren, um den Nutzer vor derzeit noch unbekannter Malware zu schützen. Die Tatsache, dass Teile der Schutztechnologien in der Cloud verbleiben, verhindert, dass sich Malware-Autoren schnell an diese aktuellen Erkennungsmechanismen anpassen können.

Testfälle

Der für diesen Test verwendete Testsatz bestand aus 10.102 Malware-Samples, die nach Abfrage von Telemetriedaten mit dem Ziel zusammengestellt wurden, aktuelle, weit verbreitete Samples einzubeziehen, die Nutzer in der Praxis gefährden. Die Malware-Varianten wurden in Clustern zusammengefasst, um eine repräsentativere Testgruppe zu bilden (d. h. um eine Überrepräsentation ein und derselben Malware in der Gruppe zu vermeiden). Die Samplecollection wurde Ende August 2020 eingestellt.

Ranking-System

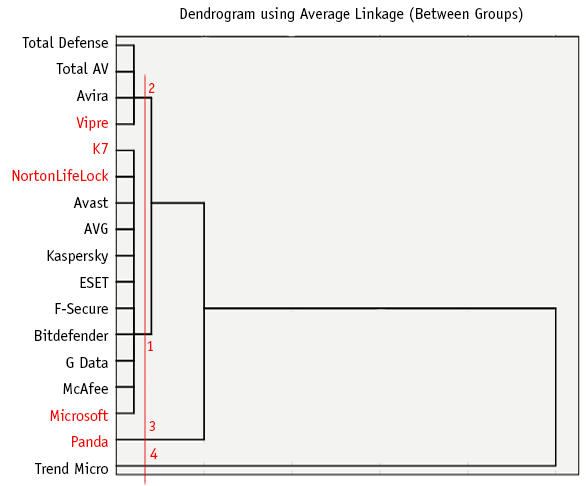

Hierarchische Clusteranalyse

Dieses Dendrogramm zeigt die Ergebnisse der Clusteranalyse über die Online-Schutzraten. Es zeigt an, auf welchem Ähnlichkeitsniveau die Cluster miteinander verbunden sind. Die rot eingezeichnete Linie definiert den Grad der Ähnlichkeit. Jeder Schnittpunkt zeigt eine Gruppe an.

Weitere Informationen zur Clusteranalyse finden Sie in diesem leicht verständlichen Tutorial: http://strata.uga.edu/software/pdf/clusterTutorial.pdf

Die Malware-Schutzraten werden von den Testern gruppiert, nachdem sie sich die mit der hierarchischen Clustermethode gebildeten Cluster angesehen haben. Allerdings halten sich die Tester in Fällen, in denen dies nicht sinnvoll wäre, nicht strikt daran. In einem Szenario, in dem alle Produkte niedrige Schutzquoten erreichen, erhalten beispielsweise die Produkte mit den höchsten Werten nicht unbedingt die höchstmögliche Auszeichnung. Die FP-Wertebereiche für die verschiedenen Kategorien können jährlich angepasst werden.

(von den Testern nach Konsultation statistischer Methoden angegeben) |

||||

| Sehr wenige (0-1 FPs) Wenig (2-10 FP's) | ||||

| Viele (11-50 FPs) | ||||

| Sehr viele (51-100 FPs) | ||||

| Auffallend viele (über 100 FPs) | ||||

Offline- vs. Online-Erkennungsraten

Viele der getesteten Produkte nutzen Cloud-Technologien, wie z.B. Reputationsdienste oder cloudbasierte Signaturen, die nur bei einer aktiven Internetverbindung erreichbar sind. Durch die Durchführung von On-Demand- und On-Access Scans sowohl offline als auch online gibt der Test einen Hinweis darauf, wie abhängig jedes Produkt von dem Cloud-Dienst ist und wie gut es das System schützt, wenn keine Internetverbindung verfügbar ist. Wir würden vorschlagen, dass Anbieter von Produkten, die stark von der Cloud abhängig sind, die Nutzer entsprechend warnen sollten, falls die Verbindung zur Cloud unterbrochen wird, da dies den gebotenen Schutz erheblich beeinträchtigen kann. Während wir in unserem Test prüfen, ob die Cloud-Dienste der jeweiligen Security-Anbieter erreichbar sind, sollten sich die Nutzer darüber im Klaren sein, dass die bloße Tatsache, dass sie online sind, nicht unbedingt bedeutet, dass der Cloud-Dienst ihres Produkts erreichbar ist und ordnungsgemäß funktioniert.

Zur Information der Leser und aufgrund häufiger Anfragen von Magazinen und Analysten geben wir auch an, wie viele der Samples von jedem Security-Programm bei den Offline- und Online-Scans erkannt wurden.

| OFFLINE Erkennungsrate |

ONLINE Erkennungsrate |

ONLINE Schutzrate |

Fehl- Alarme |

|

|---|---|---|---|---|

| Avast | 92.0% | 99.4% | 100% | 10 |

| AVG | 92.0% | 99.4% | 100% | 10 |

| Avira | 90.6% | 95.0% | 99.96% | 8 |

| Bitdefender | 95.9% | 95.9% | 99.99% | 6 |

| ESET | 90.3% | 90.3% | 99.98% | 2 |

| F-Secure | 90.6% | 94.4% | 99.99% | 9 |

| G Data | 96.5% | 96.5% | 100% | 6 |

| K7 | 89.5% | 89.5% | 99.98% | 78 |

| Kaspersky | 85.7% | 88.3% | 99.99% | 3 |

| McAfee | 79.5% | 98.7% | 100% | 10 |

| Microsoft | 70.5% | 85.0% | 100% | 21 |

| Norton | 77.4% | 98.1% | 99.98% | 41 |

| Panda | 53.5% | 86.5% | 99.89% | 114 |

| TotalAV | 90.6% | 94.0% | 99.96% | 8 |

| Total Defense | 95.9% | 95.9% | 99.96% | 6 |

| Trend Micro | 38.5% | 84.6% | 98.27% | 5 |

| VIPRE | 95.9% | 95.9% | 99.96% | 18 |

Test-Ergebnisse

Online-Gesamtschutzraten (in Gruppen zusammengefasst):

Bitte beachten Sie auch die Fehlalarmquoten, wenn Sie sich die nachstehenden Schutzquoten ansehen.

| Blockiert | User-Dependent | Kompromitiert | Schutzrate [Blocked % + (User Dependent % / 2)] | Cluster | |

|---|---|---|---|---|---|

| Avast | 10102 | - | - | 100% | 1 |

| AVG | 10102 | - | - | 100% | 1 |

| G Data | 10102 | - | - | 100% | 1 |

| McAfee | 10102 | - | - | 100% | 1 |

| Microsoft | 10102 | - | - | 100% | 1 |

| Bitdefender | 10101 | - | 1 | 99.99% | 1 |

| F-Secure | 10101 | - | 1 | 99.99% | 1 |

| Kaspersky | 10101 | - | 1 | 99.99% | 1 |

| ESET | 10100 | - | 2 | 99.98% | 1 |

| K7 | 10100 | - | 2 | 99.98% | 1 |

| NortonLifeLock | 10100 | - | 2 | 99.98% | 1 |

| Avira | 10098 | - | 4 | 99.96% | 2 |

| Total AV | 10098 | - | 4 | 99.96% | 2 |

| Total Defense | 10098 | - | 4 | 99.96% | 2 |

| Vipre | 10098 | - | 4 | 99.96% | 2 |

| Panda | 10091 | - | 11 | 99.89% | 3 |

| Trend Micro | 9927 | - | 175 | 98.27% | 4 |

Der verwendete Testsatz enthielt 10102 aktuelle/prävalente Proben aus den letzten Wochen.

False Positives (False Alarm) Test - Ergebnis

Um die Qualität der Dateierkennungsfähigkeiten (Fähigkeit, saubere Dateien von schädlichen Dateien zu unterscheiden) von Antivirus-Produkten besser beurteilen zu können, bieten wir einen False Alarm Test an. Fehlalarme können manchmal genauso viel Ärger verursachen wie eine echte Infektion. Bitte berücksichtigen Sie die False-Positives-Rate (FPs) bei der Betrachtung der Erkennungsraten, da ein Produkt, das zu Fehlalarmen neigt, leichter höhere Erkennungsraten erreichen kann. Bei diesem Test wird ein Satz sauberer Dateien gescannt, und ein repräsentativer Teil des sauberen Satzes wird ausgeführt (wie bei Malware).

| 1. | ESET | 2 | wenige FPs | |||

| 2. | Kaspersky | 3 | ||||

| 3. | Trend Micro | 5 | ||||

| 4. | Bitdefender, G Data, Total Defense | 6 | ||||

| 5. | Avira, TotalAV | 8 | ||||

| 6. | F-Secure | 9 | ||||

| 7. | Avast, AVG, McAfee | 10 | ||||

| 8. | VIPRE | 18 | viele FPs | |||

| 9. | Microsoft | 21 | ||||

| 10. | Norton | 41 | ||||

| 11. | K7 | 78 | sehr viele FPs | |||

| 12. | Panda | 114 | auffallend viele FPs | |||

Einzelheiten zu den entdeckten Fehlalarmen (einschließlich der angenommenen Häufigkeit) sind in einem separaten Bericht zu finden, der unter folgender Adresse abrufbar ist: False Alarm Test September 2020.

Ein Produkt, das einen hohen Prozentsatz schädlicher Dateien erkennt, aber gleichzeitig Fehlalarme erzeugt, ist nicht unbedingt besser als ein Produkt, das weniger schädliche Dateien erkennt, aber auch weniger Fehlalarme erzeugt.

In diesem Malware Protection Test erreichte Award Level

AV-Comparatives vergibt Ranglistenauszeichnungen, die sowohl auf der Anzahl der Fehlalarme als auch auf der Schutzrate basieren. Da dieser Bericht auch die rohen Erkennungsraten und nicht nur die Auszeichnungen enthält, können sich erfahrene Nutzer, die sich weniger Sorgen um Fehlalarme machen, natürlich auch auf die Schutzrate allein verlassen.

* Diese Produkte wurden aufgrund der Fehlalarme schlechter bewertet.

Copyright und Haftungsausschluss

Diese Veröffentlichung ist Copyright © 2020 von AV-Comparatives ®. Jegliche Verwendung der Ergebnisse, etc. im Ganzen oder in Teilen, ist NUR nach ausdrücklicher schriftlicher Zustimmung der Geschäftsführung von AV-Comparatives vor einer Veröffentlichung erlaubt. AV-Comparatives und seine Tester können nicht für Schäden oder Verluste haftbar gemacht werden, die sich aus der Verwendung der in diesem Dokument enthaltenen Informationen ergeben könnten. Wir bemühen uns mit aller Sorgfalt um die Richtigkeit der Basisdaten, eine Haftung für die Richtigkeit der Testergebnisse kann jedoch von keinem Vertreter von AV-Comparatives übernommen werden. Wir übernehmen keine Gewähr für die Richtigkeit, Vollständigkeit oder Eignung für einen bestimmten Zweck der zu einem bestimmten Zeitpunkt bereitgestellten Informationen/Inhalte. Niemand, der an der Erstellung, Produktion oder Lieferung von Testergebnissen beteiligt ist, haftet für indirekte, besondere oder Folgeschäden oder entgangenen Gewinn, die sich aus der Nutzung oder der Unmöglichkeit der Nutzung der auf der Website angebotenen Dienste, Testdokumente oder damit zusammenhängenden Daten ergeben oder damit zusammenhängen.

Für weitere Informationen über AV-Comparatives und die Testmethoden besuchen Sie bitte unsere Website.

AV-Comparatives

(Oktober 2020)